Pendant longtemps un certain nombre de phénomènes physiques ont intrigué les physiciens car ils semblaient contraire au second principe de la thermodynamique. Ces phénomènes, qualifiés de dissipatifs par Ilya Prigogine <a href= »http://www.philo5.com/Les vrais penseurs/03 – Ilya Prigogine.htm »>(1)</a>, apparaissent toujours dans des systèmes traversés par des flux importants d’énergie. C’est le cas par exemple de l’apparition spontanée de mouvements ordonnés dans un fluide soumis à des différences de température ou de pression. La diminution d’entropie observée est en fait compatible avec le second principe parce que ces systèmes ne sont pas isolés, mais le second principe ne les explique pas. Nous allons voir ici comment le principe de production maximale d’entropie les explique avant d’aborder son application au phénomène plus compliqué qu’est la vie.

En 1900, dans son mémoire de thèse intitulé “Les tourbillons cellulaires dans une nappe liquide”, Henri Bénard, alors étudiant à la Sorbonne, mettait en évidence l’apparition de cellules hexagonales régulières dans un film d’huile dont les deux surfaces sont soumises à une forte différence de température. Ces cellules rappellent étrangement des structures créées par des êtres vivants comme les nids d’abeilles ou les cellules animales ou végétales. À cette époque on pensait que seuls les êtres vivants pouvaient créer de telles structures.

Ces cellules, appelées depuis cellules de Bénard <a href= »http://fr.wikipedia.org/wiki/Cellules_de_Bénard « >(2)</a>, sont des cellules convectives à l’intérieur desquelles l’huile circule comme l’eau dans une casserole sur le feu. Chauffé par en dessous, le liquide se dilate. Il devient donc moins dense et monte à la surface où il se refroidit avant de redescendre autour de la cellule. Ce phénomène se produit naturellement à la surface du soleil. C’est la granulation solaire <a href= »http://www.cite-sciences.fr/francais/ala_cite/expo/tempo/planete/portail/planete/video.php?film=42&debit=1″>(3)</a> découverte par Janssen <a href= »http://www.cosmovisions.com/Janssen.htm »>(4)</a> en 1889. Moins réguliers que les cellules créées par Bénard, les granules solaires sont environ deux cent millions de fois plus grand, un rapport de taille plus grand que celui d’une bactérie à un éléphant. Ainsi un même processus physique peut produire des phénomènes analogues à des échelles extrêmement différentes.

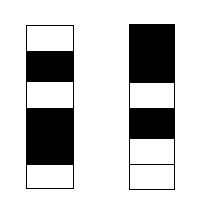

|

| Cellules de Bénard |

Il s’agit bien d’un système traversé par un flux important d’énergie, ici un flux de chaleur. Lorsque la différence de température est faible, la chaleur se propage par conduction: l’agitation des molécules se propage simplement par collisions d’un molécule à une autre sans déplacement du fluide. Lorsque la différence de température devient plus élevée, un nouveau moyen de transport de la chaleur apparaît: la convection. Il y a apparition d’un mouvement d’ensemble ordonné des molécules. La diminution d’entropie liée à cette apparition d’ordre est entièrement compensée par la dissipation plus élevée de chaleur à la surface du fluide.

Il y a en fait compétition entre deux moyens de transport de l’énergie: la conduction et la convection. Lorsque le flux de chaleur est important, la conduction n’est plus assez efficace pour transporter l’énergie. L’individualisme des molécules ne paie plus et, l’union faisant la force, la convection l’emporte. D’une façon générale, c’est toujours le moyen de transport le plus efficace qui l’emporte puisqu’il dérobe l’énergie aux autres. Le résultat est bien une évolution vers un maximum de dissipation d’énergie, conformément au principe de production maximale d’entropie.

Ce n’est pas par hasard si les cellules de Bénard font instinctivement penser à des phénomènes liés à la vie. Comme tous les phénomènes dissipatifs, elles en possèdent au moins trois caractéristiques:

<ul>

<li>

a) Le métabolisme: les cellules de Bénard ne subsistent que si elles sont constamment alimentées en énergie. Lorsque l’apport d’énergie cesse, elles disparaissent comme un individu meurt lorsqu’il n’est plus alimenté.</li><li>

b) Le comportement imprévisible: la position, le nombre ou la forme exacte des cellules de Bénard varient d’une expérience à une autre comme les cellules diffèrent entre deux individus d’une même espèce. </li><li>

c) La sélection naturelle: un changement de régime comme le passage de la conduction à la convection porte, en hydrodynamique, le nom de bifurcation. Nous verrons que c’est un mécanisme tout à fait analogue à celui de l’apparition de nouvelles espèces animales ou végétales. Les cellules de Bénard ne peuvent se développer que dans des conditions où elles l’emportent sur un phénomène dissipatif concurrent comme la conduction. C’est le mécanisme même de la sélection naturelle découvert par Darwin.</li></ul>

Lorsque le transport de chaleur se fait par conduction, les molécules du fluide situées près de la surface chaude ne reçoivent aucune information sur ce qui se passe près de la surface froide. Elles se contentent de transmettre par collision de l’énergie cinétique aux molécules voisines sans “savoir” ce qu’il s’y passe ailleurs. L’énergie se transmet ainsi de proche en proche jusqu’à la surface froide.

Lorsque la convection s’établit, les molécules qui se sont refroidies près de la surface froide redescendent vers la surface chaude. Elles y apportent donc une information sur la température de la surface froide. Une communication s’établit. Si un changement de température survient au niveau de la surface froide, l’information est aussitôt transmise au niveau de la surface chaude où les molécules réagissent en conséquence. C’est ainsi qu’une diminution de la différence de température entraîne une diminution de la différence de densité entre le fluide ascendant et descendant donc une diminution de la convection. Inversement, une augmentation de la différence de température se traduit par une augmentation de la convection, qui elle-même tend à réduire cette différence de température.

Ce phénomène de régulation thermique est caractéristique d’une boucle d’asservissement qui s’est formée ainsi naturellement. C’est elle qui maintient l’ordre et la régularité du mouvement. Elle est responsable de la diminution locale d’entropie. Le cycle de la matière dans une cellule convective est tout à fait analogue au cycle du fluide dans une machine thermique comme le cycle de Carnot. Une caractéristique souvent oubliée des machines de Carnot est qu’elles nécessitent toutes un asservissement. Dans la machine de Denis Papin, un opérateur devait intervenir pour régler l’admission de la vapeur dans le cylindre. C’est James Watt qui automatisa non seulement l’admission de la vapeur dans le cylindre mais aussi la vitesse de rotation grâce à son régulateur à boules. Les moteurs de voiture actuels doivent leur rendement à d’innombrables boucles d’asservissement.

Les boucles d’asservissement sont à la base de l’automatique et de la cybernétique <a href= »http://fr.wikipedia.org/wiki/Cybernétique »>(5)</a>, science qui conduit à l’intelligence artificielle. Elles caractérisent les mécanismes d’apprentissage des êtres vivants, mécanismes qui se traduisent par l’apparition de la conscience. On peut définir la conscience comme la faculté de s’inclure soi-même dans son modèle interne du monde extérieur, ce qui est une sorte de boucle d’asservissement. On admet généralement que le passage du non-conscient au conscient est progressif. Il y a donc plusieurs degrés de conscience.

La conscience apparaît comme une propriété globale qui semble émerger chez les êtres vivants évolués. Le degré de conscience pourrait donc être une mesure de la complexité d’un système cybernétique. Pour moi, l’unité de conscience est une boucle d’asservissement élémentaire, comme le bit est une unité d’information. Sans voir, comme Teilhard de Chardin <a href= »http://www.richmond.edu/~jpaulsen/teilhard/citation.html « >(6)</a>, de la conscience partout y compris dans une pierre, je dirais qu’une cellule de Bénard a déjà un degré de conscience élémentaire. Elle est consciente d’une différence de température et réagit en conséquence.

(1) Voir par exemple:

http://www.philo5.com/Les%20vrais%20penseurs/03%20-%20Ilya%20Prigogine.htm

(2) Voir: http://fr.wikipedia.org/wiki/Cellules_de_Bénard

(3) Voir l’animation:

http://www.cite-sciences.fr/francais/ala_cite/expo/tempo/planete/portail/planete/video.php?film=42&debit=1

(4) Voir par exemple: http://www.cosmovisions.com/Janssen.htm

(5) Voir: http://fr.wikipedia.org/wiki/Cybernétique

(6) Teilhard de Chardin, Le phénomène humain (Seuil, 1970).

Voir aussi : http://www.richmond.edu/~jpaulsen/teilhard/citation.html

(7) Illustration tirée du livre: Into the cool, E. D. Schneider and D. Sagan (Univ. of Chicago Press, 2005). D’après: Koschmieder, E. L., Bénard cells and Taylor vortices (Cambridge Univ. Press).